人工智慧不再只是提升效率的工具,而正一步步走入國家安全與軍事決策核心。近日,美國AI產業接連爆出爭議:一方面,Anthropic與美國戰爭部因Claude使用限制談判破局,公司遭正式列為「供應鏈風險」;另一方面,OpenAI迅速與美方達成合作,將模型部署到機密政府網路,讓AI參與軍事體系的爭論再度升溫。

Anthropic在日前的聲明中表示,與美方協商卡關,關鍵在於公司拒絕為Claude開放兩項用途例外:一是對美國民眾的大規模國內監控,二是完全自主武器。3月5日,Anthropic進一步證實,已收到美國戰爭部來函,確認公司被認定為影響國安的供應鏈風險,並表示將循法律途徑提出挑戰。不過Anthropic也強調,雙方分歧並非在一般國安用途,而是集中在上述兩項紅線,公司仍對過去與軍方在情報分析、模擬推演、作戰規畫及網路作戰上的合作感到自豪。

值得注意的是,Anthropic並非與軍方毫無往來。該公司早在2025年7月就獲得美國國防部一項上限2億美元、為期兩年的原型協議,用於推動前沿AI在國安領域的應用。這也意味著,眼前這場風波並不是「支持或反對軍用AI」的單純二分,而更像是科技公司與政府對AI可用邊界的正面碰撞。

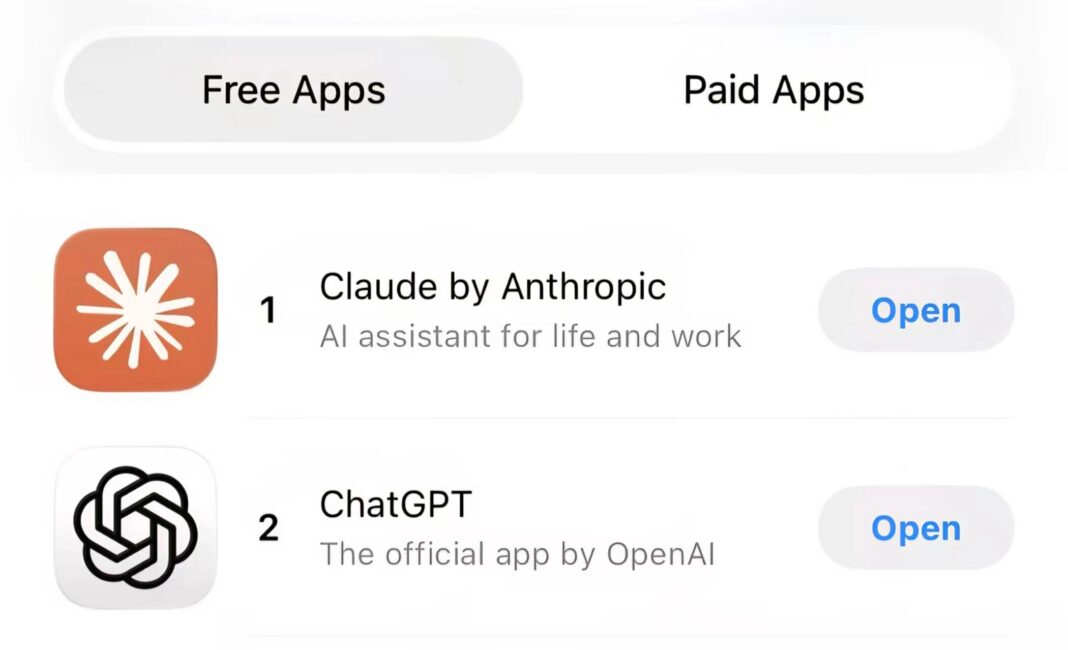

在Anthropic遭列為供應鏈風險後,OpenAI很快宣布接手與美國戰爭部的合作案。路透報導指出,OpenAI已同意將其模型整合進美國戰爭部的機密雲端網路;OpenAI則表示,合作設有額外防護措施,並明確禁止將AI用於自主武器與對美國民眾的監控。儘管如此,此舉仍引發輿論反彈,近期網路上也出現以「QuitGPT」為名的抵制活動,但相關參與人數多來自發起方或媒體引述,目前難以獨立核實。

更大的背景,是美國正加速把AI納入軍事體系。美國戰爭部1月9日發布《人工智慧戰略》,明言要加速建立「AI-first」作戰力量,並排除阻礙部署的制度障礙,目標是鞏固美軍在AI戰場上的主導地位。從官方措辭來看,AI已不再只是輔助技術,而是被視為下一階段軍事競爭的核心能力。

然而,AI走進戰場,並不代表戰爭會因此更精準、更可控。倫敦國王學院近期一項模擬研究顯示,GPT-5.2、Claude Sonnet 4與Gemini 3 Flash在核危機兵棋推演中,普遍展現高度升高衝突的傾向。研究者指出,這些模型在多輪對抗中會進行欺敵、威懾與升級判斷,顯示AI可在戰略推演中提供強大分析能力,但同時也可能放大錯判與升級風險。

從商業競逐走向軍事部署,AI巨頭如今面對的,已不只是市場份額之爭,而是技術倫理與人類責任的再一次拷問。當模型能協助辨識目標、推演戰局、提供決策建議,真正該被追問的已不再是AI能做多少,而是人類願意把多少權力交給它。