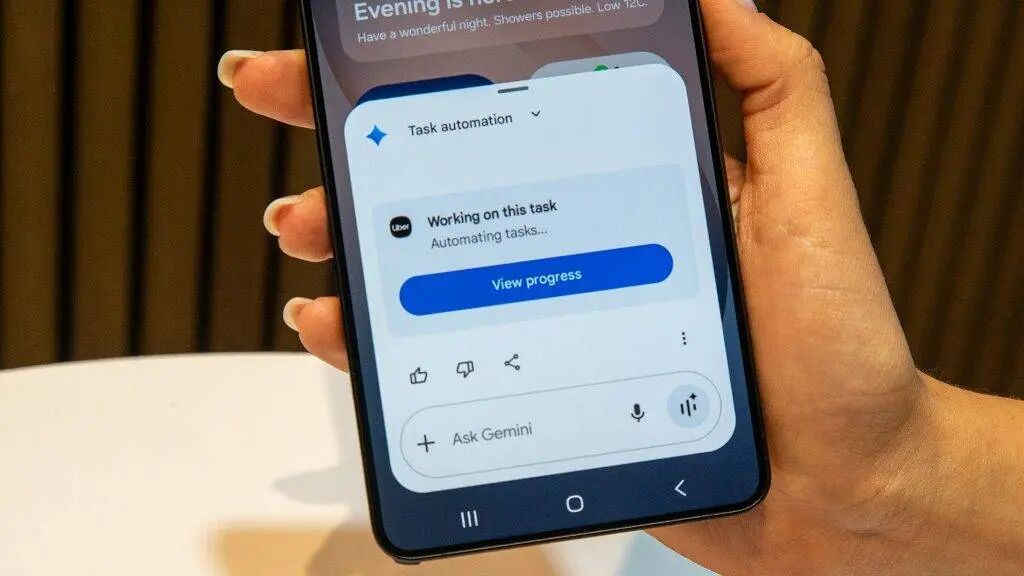

Google 與三星在近期發表會上揭示 Galaxy S26 系列的一項「系統級 AI 智慧體」新能力:使用者只要用語音下指令,Gemini 就能在手機上替你完成多步驟任務,例如透過 Uber 叫車、在 DoorDash/Grubhub 等平台點餐,並在關鍵環節請你確認付款或車型選擇。這套功能目前仍屬早期預覽/測試,首波僅在美國與南韓開放,並預計隨 Galaxy S26(3 月 11 日起)與後續 Pixel 10 等裝置逐步擴大。

業界將它形容為「Google 版豆包手機」,關鍵不在多會聊天,而在「能替你動手做事」。從技術路徑看,Gemini 同時採用「讀屏理解+系統/應用層 API」雙軌並行:一方面像人類一樣讀懂畫面、推理下一步要點哪裡;另一方面也透過更規範的系統/開發者介面降低風險。相較於過去部分手機助手高度依賴讀屏與系統權限、容易與國民級 App 產生摩擦,Google 這次選擇把能力往「生態可控、可協作」的方向推。

為了安全與隱私,Gemini 的自動操作並非直接「接管整支手機」,而是把被操作的 App 放進一個「虛擬視窗」中執行,外界可理解為沙箱化的虛擬環境:使用者能隨時查看進度、介入或中止,系統也強調它不會任意觸及裝置上其他 App 或檔案。

實際示範情境也更貼近日常:例如群組聊天討論聚會訂披薩,使用者一句「幫我整理訂單」,Gemini 可抓取訊息內容、整理每個人的口味,再到外送平台把品項加入購物車,最後交給使用者確認下單;若遇到店家限制規格,Gemini 也會提出替代方案(如改點兩個中份)。

Google Android 生態系統總裁 Sameer Samat 也指出,Gemini 不是背答案式記住操作腳本,而是透過推理模仿人類看螢幕做決策,代表未來可擴展到更多類型 App 與場景。

外界更關注的是「Android 的棋局」。當 Google 以作業系統掌控者身分,把智慧體做進系統與生態規範裡,手機可能從「裝 App 的平台」轉向「替人完成任務的智能系統」:誰能提供最順的任務閉環、誰能訂下開發者介面與安全邊界,誰就更接近下一代入口。

Galaxy S26 只是起點,Gemini 智慧體若能在 Android 17 與更多裝置普及,將對整個行動生態的服務分發、使用者習慣與 App 設計邏輯帶來連鎖效應